Analyse structurale en 7 tapes p'159,175 - PowerPoint PPT Presentation

1 / 38

Title:

Analyse structurale en 7 tapes p'159,175

Description:

(2) Construire le diagramme de cheminement repr sentant les relations causales ... RMR: entre 0 et 1. R gle du pouce: SRMR 0,05 pour un bon ajustement ... – PowerPoint PPT presentation

Number of Views:43

Avg rating:3.0/5.0

Title: Analyse structurale en 7 tapes p'159,175

1

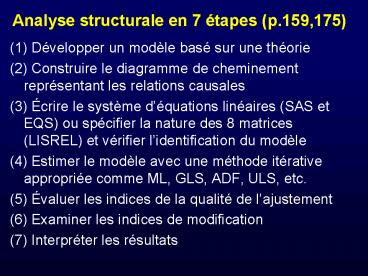

Analyse structurale en 7 étapes (p.159,175)

- (1) Développer un modèle basé sur une théorie

- (2) Construire le diagramme de cheminement

représentant les relations causales - (3) Écrire le système déquations linéaires (SAS

et EQS) ou spécifier la nature des 8 matrices

(LISREL) et vérifier lidentification du modèle - (4) Estimer le modèle avec une méthode itérative

appropriée comme ML, GLS, ADF, ULS, etc. - (5) Évaluer les indices de la qualité de

lajustement - (6) Examiner les indices de modification

- (7) Interpréter les résultats

2

Coefficients de corrélation (Bollen, p.441)

- 2 var. continues (métriques) PEARSON 2

var. ordinales SPEARMAN, KENDALL (corr.

polychorique chaque var. prend plus de 2

valeurs) - 2 var. binaires Tétrachorique

- 1 var. continue et 1 var. ordinale ayant

plus de 2 valeurs Polysériale 1

var. continue et 1 var. binaire Bisériale - Comment traiter une variable nominale à plusieurs

modalités ?

3

Ancrer une échelle de mesure sur une variable

latente

- Selon Mueller p. 73

- 1- Il faut un l 1 par variable latente

- ou bien

- 2- PHI(1,1) PHI(2,2) .1

- Conséquences au niveau de lajustement du modèle

?

4

Mueller p. 76 exemple en AFC

5

Mueller p. 78 exemple en AFC

6

Mueller p. 78 exemple en AFC

- HSRank l42 (AcRank) d

- Un seul indicateur ------? d 0 et Var(d) 0

- Puisque Var(HSRank) 0.604 , Var(d) 0 et

Var(AcRank) 1, alors l42 ? - Réponse 0.604 (l42)2 (1) 0 ----? l42 0.777

7

Mueller p. 78 exemple en AFC

8

Mueller p. 78 exemple en AFC

9

Ancrer une échelle de mesure sur une variable

latente (suite)

- Suggestion

- 1- lambda(1,1) 1

- 2- PHI(2,2) 1

- Conséquences au niveau de lajustement du modèle

?

10

Mueller p. 76 exemple en AFC

11

Mueller p. 78 exemple en AFC

12

Mueller p. 78 exemple en AFC

13

Mueller p. 78 exemple en AFC

14

Indices de modification

- 1- SAS

- PROC CALIS COV MOD

- 2- LISREL

- OU MI MEGLS ADoff ND3

- 3- EQS

- /LMTEST

- SetGFF,PEE

- /WTEST

- DIGIT3

15

MES notation LISREL (p. 160)

16

Multiplicateurs de Lagrange

17

ML via LISREL (p. 168)

18

MES notation EQS (p. 169)

19

ML via EQS (p. 172)

20

ML via EQS (p. 172)

21

EXEMPLE PEDHAZUR p. 727

Erreur

HM1

Habilité mentale

Erreur

Erreur

HM2

Erreur

HM3

Image de soi

Performance académique

Erreur

IS1

IS3

IS2

PA3

PA1

PA2

Erreur

Erreur

Erreur

Erreur

Erreur

Erreur

22

NOTATION LISREL (sauf six lambdas)

X1

d1

1

?1 Habilité mentale

?2

d2

X2

?21

?11

d3

X3

?2 Image de soi

b21

?1 Performance académique

1

Y4

Y6

Y5

1

?1

Y3

Y1

Y2

e5

e6

e4

e3

e2

e1

23

ML via LISREL (PEDHAZUR p. 727)

24

ML via LISREL (PEDHAZUR p. 727)

25

ML via LISREL (PEDHAZUR p. 727)

26

Root Mean Square Residual RMR (Bollen, p. 257)

- RMR a été proposé par Jöreskog et Sörbom en 1986.

- RMR est difficile à interpréter quand la matrice

des covariances est analysée, à cause des unités

de mesure des variables. RMR est

plus appropriée si elle est calculée avec les

corrélations. - Standardized RMR entre 0 et 1. Règle

du pouce SRMR lt 0,05 pour un bon ajustement

27

Incremental fit index IFI (Bollen, p. 271)

- IFI a été proposé par Bollen en 1989.

- Selon certains, CFI et IFI sont les indices les

plus populaires IFI corrige

certains défauts de lindice NNFI ( lt0, gt1, trop

petit si n est faible)

28

Critical N CN (Bollen, p. 277 Hoyle 93)

- Critical N a été proposé par Hoelter en 1983.

- CN ? 200 indique que le modèle est adéquat pour

les données. - Exemple a 0,01 et dl 24 ?

Khi-carré critique 42,98 CN (42,98 / 0,15)

1 287,53 gt 200

29

Fidélité Reliability (PEDHAZUR p. 727)

À voir les imprimés PED727.PTH et PED727.OUT

30

NOTATION EQS

E7

V7

F3 Habilité mentale

D2

E8

V8

E9

V9

F2 Image de soi

F1 Performance académique

V4

V6

V5

D1

V3

V1

V2

E5

E6

E4

E3

E2

E1

31

EQS (PEDHAZUR p. 727)

GOODNESS OF FIT SUMMARY INDEPENDENCE MODEL

CHI-SQUARE 805.064 ON 36 DEGREES OF

FREEDOM INDEPENDENCE AIC 733.06418

INDEPENDENCE CAIC 578.32476 MODEL

AIC -18.18121 MODEL CAIC

-121.34082 CHI-SQUARE 29.819 BASED ON

24 DEGREES OF FREEDOM PROBABILITY VALUE FOR

THE CHI-SQUARE STATISTIC IS 0.19083 THE

NORMAL THEORY RLS CHI-SQUARE FOR THIS ML SOLUTION

IS 28.662. BENTLER-BONETT NORMED

FIT INDEX 0.963 BENTLER-BONETT NONNORMED

FIT INDEX 0.989 COMPARATIVE FIT INDEX

(CFI) 0.992 ITERATIVE SUMMARY

PARAMETER ITERATION

ABS CHANGE FUNCTION 1

42.292736 29.16202

2 528.183411

19.39098 3 43272.484400

19.81291 4

37024.593800 18.68308 5

5342.509280

17.77084 6 4374.743650

14.70848

17 0.001240

0.14984 18 0.000574

0.14984

32

EQS (PEDHAZUR p. 727)

MAXIMUM LIKELIHOOD SOLUTION (NORMAL DISTRIBUTION

THEORY) STANDARDIZED SOLUTION

R-SQUARED AA1 V1 .65 F1 .76

E1 .429

AA2 V2 .77F1 .64 E2

.595 AA3 V3

.74F1 .67 E3

.547 SC1 V4 .73 F2 .69

E4 .526

SC2 V5 .69F2 .73 E5

.472 SC3 V6

.68F2 .73 E6

.467 MA1 V7 .86 F3 .51

E7 .737

MA2 V8 .82F3 .57 E8

.678 MA3 V9

.89F3 .46 E9

.784 ACADEMICF1 .65F3 .76

D1 .426

SELFCONCF2 .31F1 .44F3 .73

D2 .465

33

Violation des postulats avec ML, GLS (Hoyle,

p.59)

- En pratique, la majorité des variables ne

suivent pas une distribution normale, encore

moins multivariée normale. - Cas I Conséquences pour Variables continues non

normales - 1) Estimateurs non biaisés, convergents mais

non efficaces 2) Le khi-deux et les tests T

trop significatifs 3) Les

indices dajustement trop faibles - Cas II Conséquences pour Variables continues

mesurées sur des échelles ordinales (categorized

variables) - 1) Estimateurs biaisés 2) Le

khi-deux et les tests T trop significatifs

3) Atténuation des coefficients de corrélation

34

Détection de la non-normalité (Hoyle, p.60)

- Rappel

- Dans une distribution normale, le coefficient

dasymétrie de Fisher (skewness)

est égal à 0 et le coefficient

daplatissement de Fisher (kurtosis)

est égal à 3. - A) Tests univariés de normalité

1) Khi-deux, Kolmogorov-Smirnov,

Shapiro-Wilks , etc. 2) Tests séparés

dasymétrie et daplatissement Bollen 421

3) Test conjoint

35

Détection de la non-normalité (Hoyle, p.60)

- B) Tests multivariés de normalité

1) Test séparés dasymétrie et

daplatissement de Mardia (1970, 74, 85) Bollen

p. 424 2) Test conjoint de

Mardia fait par SIMPLIS, EQS - C) Détection de données aberrantes (outliers)

1) Cas univarié via les histogrammes des

variables 2) Cas multivarié via la distance de

Mahalanobis

36

Remèdes pour la non-normalité (Hoyle, p.64)

- Méthode ADF Asymptotically Distribution-free

n gt 1000 modèles simples - n gt 5000 modèles complexes

- B) Khi-carré ajusté (Scaled khi-square, Satorra

et Bentler 1990) on divise le khi-carré par

une constante qui dépend de 1- modèle

2- le coefficient

daplatissement multivarié 3- les degrés de

liberté du modèle On exige n entre 200 et

500 cas pour de bons résultats. - C) Ré-échantillonnage (Bootstrapping) on prélève

des échantillons de taille n , avec remise, à

partir de léchantillon original de n sujets.

Ceci permet dobtenir des distributions

empiriques des estimations.

37

Remèdes pour la non-normalité (Hoyle, p.68)

- D) Pour variables catégorisées Muthen en 1984 a

développé un estimateur non biaisé, convergent et

efficace appelé dans M-PLUS lestimateur CVM

(continuous/categorical variable methodology). Il

analyse simultanément des variables

dichotomiques, ordinales, et métriques. La taille

déchantillon gt 500-1000 sujets. - Postulat de cette méthode CVM une variable

latente normale (0,1) se cache derrière chaque

variable observée.

38

Remèdes pour la non-normalité (Hoyle, p.68)

- D) suite

- Pour contrer leffet datténuation dans

lestimation des coefficients de corrélation,

utiliser un coefficient tétrachorique,

polychorique, polysérial, etc. selon le besoin. - CVM est à son meilleur si i) les

variables ont peu de catégories et ii) les

variables sont très asymétriques et dans des

directions variées.